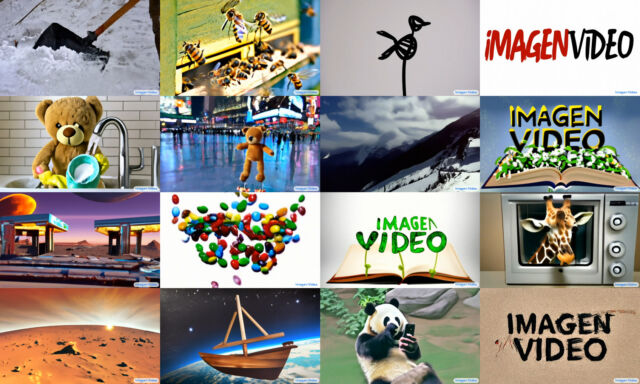

Aujourd’hui, Google a annoncé le développement d’Imagen Video, un mode d’intelligence artificielle texte-vidéo capable de produire des vidéos 1280 × 768 à 24 images par seconde à partir d’une invite écrite. Actuellement, il est en phase de recherche, mais son apparition cinq mois après Google Imagen indique le développement rapide des modèles de synthèse vidéo.

Six mois seulement après le lancement du générateur de texte en image DALLE-2 d’OpenAI, les progrès dans le domaine des modèles de diffusion de l’IA se sont accélérés rapidement. L’annonce Imagen Video de Google intervient moins d’une semaine après que Meta a dévoilé son outil d’intelligence artificielle texte-vidéo, Make-A-Video.

Selon le document de recherche de Google, Imagen Video comprend plusieurs capacités stylistiques notables, telles que la génération de vidéos basées sur le travail de peintres célèbres (les peintures de Vincent van Gogh, par exemple), la génération d’objets rotatifs 3D tout en préservant la structure de l’objet et le rendu de texte dans une Crumpa de styles d’animation. Google espère que les modèles de synthèse vidéo à usage général pourront « réduire considérablement la difficulté de la génération de contenu de haute qualité ».

La clé des capacités d’Imagen Video est une « cascade » de sept modèles de diffusion qui transforment l’invite de texte initiale (telle que « un ours faisant la vaisselle ») en une vidéo basse résolution (16 images, 24 × 48 pixels, à 3 ips ), puis le met à l’échelle dans des résolutions progressivement plus élevées avec des fréquences d’images plus élevées à chaque étape. La vidéo de sortie finale dure 5,3 secondes.

Les exemples de vidéos présentés sur le site Web d’Imagen Video vont du plus banal (« Faire fondre de la crème glacée dégoulinant du cône ») au plus fantastique (« Voler à travers une bataille intense entre des navires pirates sur un océan orageux »). Ils contiennent des artefacts évidents, mais montrent plus de fluidité et de détails que les modèles de texte à image précédents tels que CogVideo qui a fait ses débuts il y a cinq mois.

Un autre modèle de texte en vidéo adjacent à Google a également officiellement fait ses débuts aujourd’hui. Appelé Phenaki, il peut créer des vidéos plus longues à partir d’invites détaillées. Cela, avec DreamFusion, qui peut créer des modèles 3D à partir d’invites de texte, montre que le développement concurrentiel sur les modèles de diffusion se poursuit rapidement, avec le nombre d’articles sur l’IA sur arXiv croissance exponentielle à un rythme qui rend difficile pour certains chercheurs continuez avec les derniers développements.

Les données d’entraînement pour Google Imagen Video proviennent de l’ensemble de données image-texte LAION-400M accessible au public et de « 14 millions de paires vidéo-texte et 60 millions de paires image-texte », selon Google. En conséquence, il a été formé sur des « données problématiques » filtrées par Google, mais peut toujours contenir des contenus sexuellement explicites et violents, ainsi que des stéréotypes sociaux et des préjugés culturels. L’entreprise craint également que son outil ne soit utilisé « pour générer du contenu faux, haineux, explicite ou préjudiciable ».

Par conséquent, il est peu probable que nous voyions une version publique de sitôt : « Nous avons décidé de ne pas publier le modèle Imagen Video ou son code source tant que ces préoccupations ne seront pas atténuées », déclare Google.