Jusqu’à présent, le terme «art IA» signifiait «images statiques». Plus maintenant. Meta présente Make-A-Video, où la société combine l’art de l’IA et l’interpolation pour créer de courts GIF vidéo en boucle.

Make-A-Video.studio n’est pas encore accessible au public. Au lieu de cela, il est montré comme ce que Meta lui-même peut faire avec la technologie. Et oui, bien qu’il s’agisse techniquement de vidéo – dans le sens où il y a plus que quelques images d’art IA enchaînées – c’est probablement encore plus proche d’un GIF traditionnel qu’autre chose.

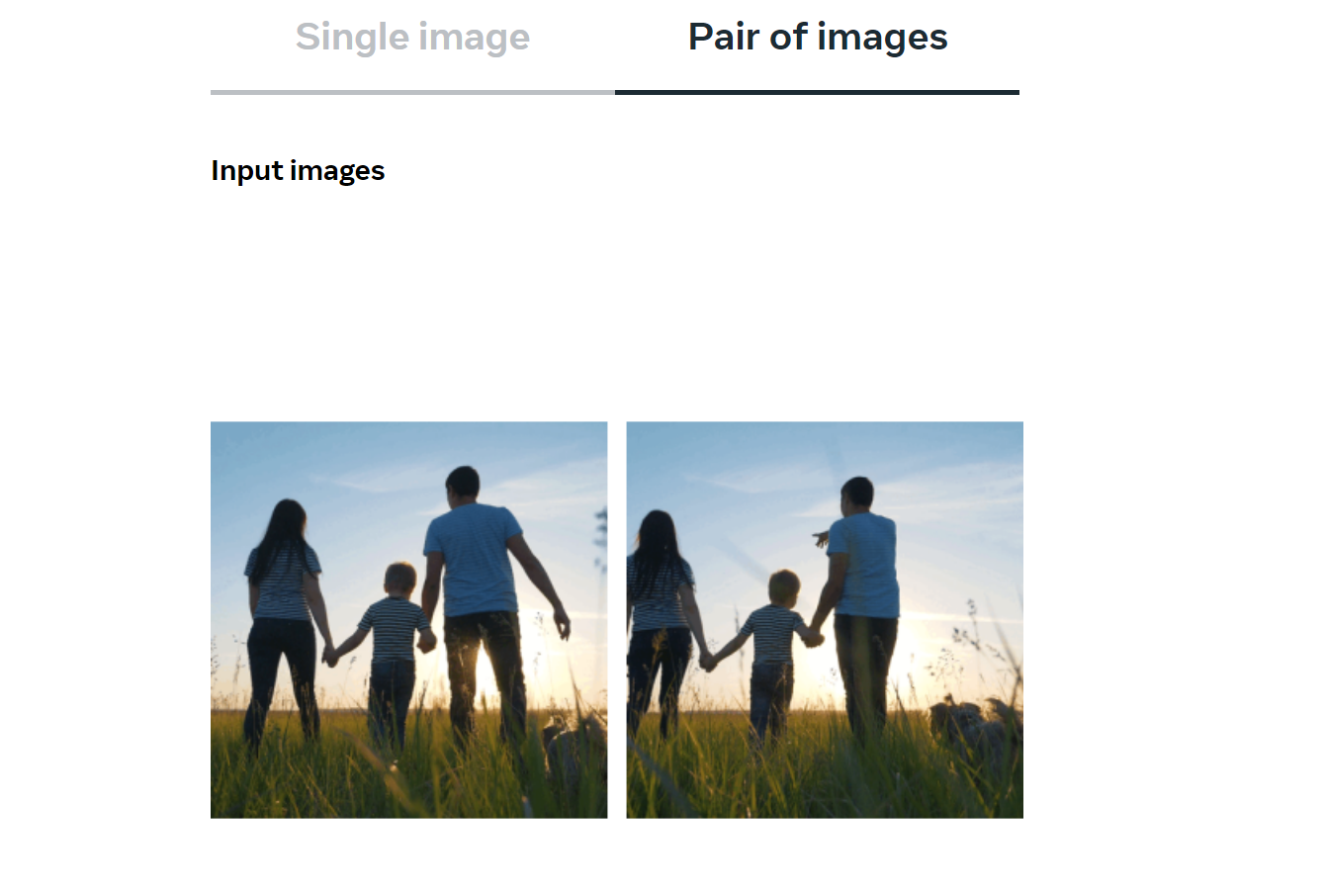

Peu importe. Ce que Make-A-Video accomplit est triple, compte tenu de la démonstration sur le site de Meta. Premièrement, la technologie peut prendre deux images liées – qu’il s’agisse d’une goutte d’eau en vol ou de photos d’un cheval au galop complet – et créer les cadres intermédiaires. Plus impressionnant encore, Make-A-Video semble être capable de prendre une image fixe et de lui appliquer un mouvement de manière intelligente, en prenant une image fixe d’un bateau, par exemple, et en créant une courte vidéo de celui-ci se déplaçant sur les vagues.

Enfin, Make-A-Video peut tout mettre en place. À partir d’une invite, « un ours en peluche peignant un portrait », Meta a montré un petit GIF d’un ours en peluche animé se peignant. Cela montre non seulement la capacité de créer de l’art de l’IA, mais aussi d’en déduire une action, comme l’indique le document de recherche de l’entreprise.

Méta

« La recherche Make-A-Video s’appuie sur les progrès récents réalisés dans la technologie de génération de texte en image conçue pour permettre la génération de texte en vidéo », explique Meta. « Le système utilise des images avec des descriptions pour savoir à quoi ressemble le monde et comment il est souvent décrit. Il utilise également des vidéos sans étiquette pour apprendre comment le monde bouge. Avec ces données, Make-A-Video vous permet de donner vie à votre imagination en générant des vidéos fantaisistes et uniques en quelques mots ou lignes de texte.

Cela signifie probablement que Meta entraîne l’algorithme sur une vidéo réelle qu’il a capturée. Ce qui n’est pas clair, c’est comment cette vidéo est entrée. Le document de recherche de Facebook sur le sujet n’indique pas comment la vidéo pourrait être obtenue à l’avenir, et il faut se demander si la vidéo anonymisée capturée à partir de Facebook pourrait être utilisée comme graine pour l’art futur.

Ce n’est pas entièrement nouveau, du moins conceptuellement. Des animations comme VQGAN + clip Turbo peuvent prendre une invite de texte et la transformer en une vidéo animée, mais le travail de Meta semble plus sophistiqué. C’est difficile à dire, cependant, jusqu’à ce que le modèle soit publié pour qu’un public puisse jouer avec.

Néanmoins, cela amène l’art de l’IA dans une autre dimension : celle du mouvement. Combien de temps faudra-t-il avant que Midjourney et Stable Diffusion fassent de même sur votre PC ?